云原生和微服务时代,构建和运维可靠、高性能的应用系统,已远非“写好代码”这么简单。在分布式系统中,一次请求可能横跨数十个服务、涉及多个团队和技术栈;微小的延迟或异常,都可能像多米诺骨牌般引发连锁故障。如果没有全面、实时的“眼睛”去看清系统内部状态,定位问题往往靠猜、靠经验主义,效率低下、成本高昂。

可观测性正是解决这个痛点的关键实践。

可观测性让你从外部数据“反推”系统内部状态。其核心价值体现在:

- 快速故障定位:传统监控只能告诉你“坏了”,可观测性能告诉你“为什么坏了、在哪坏了、影响了谁”。

- 提升开发效率:减少“排查时间”,从几天到几分钟,团队能够把精力放在业务创新而不是救火。

- 优化资源与成本:精准发现瓶颈,避免盲目加机器;理解真实负载,合理采样和降本。

- 支持业务决策:链路+指标+日志关联,能看到“这个功能慢了,用户流失率涨了多少”类似的闭环洞察。

要实现真正的可观测性,插桩(Instrumentation)是第一步,它决定了你能采集到什么样的遥测数据(Telemetry)。插桩主要分为以下几类:

- 手动插桩(Manual Instrumentation),开发者通过日志改造或者用OTel API/ SDK在代码里主动创建Span、加Attribute、记Metric/Log,侵入性最高,但最精准、最可控,适合业务关键路径、自定义指标、框架未覆盖的场景。

- 自动插桩(Automatic / Zero-code Instrumentation),不改业务代码,通过运行时机制自动生成遥测。自动插桩又分以下几种:

字节码注入(Bytecode Instrumentation):Java、.NET主流。启动挂Agent(如Java Agent),JVM/CLR加载类时动态改写字节码,在方法前后插入Span创建/传播/结束逻辑(用ByteBuddy等工具)

猴子补丁(Monkey Patching):Python、Node.js常用。运行时动态替换/包裹库函数(如Requests、Flask视图),在调用前后加观测钩子

模块加载钩子/Require Hook:Node.js特色,拦截模块加载时装饰函数

eBPF插桩:内核级探针或编译时修改,几乎零开销,但生态还在成熟

编译期插桩:Go等静态编译语言,在构建过程中通过抽象语法树(AST)操作转换源代码

语言运行时API:PHP 8.0引入的Observer API,在Zend引擎级别Hook到PHP引擎的执行流程

- 混合插桩:自动插桩覆盖基础设施,手动补业务细节 + 关键上下文。

刚开始,很多用户会选择自动插桩的方式,且上完之后没有进行迭代优化运营,容易产生很多问题。如果这些问题没有处理好,会导致信噪比下降、存储成本暴涨、查询性能变差等,而真正有价值的错误链路和业务洞察反而被淹没。

在《How to Reduce Telemetry Volume by 40% Smartly(Java)》一文中,以最常见Java Agent自动插桩为例,列举了最常见的一些问题:

- URL路径和Target属性,HTTP客户端和服务器的自动插桩常常捕获完整的http.url或http.target属性。例如,如果你的RESTful接口路径带唯一ID(如/api/products/12345),每个不同的ID都会生成一个全新的属性值……这会导致无法有效聚合(比如无法把它们归到模板化的/api/products/:id路由下),最终产生数百万个无用数据点,也就是浪费的遥测数据。所以需要始终优先使用模板化的http.route,而不是原始路径。

- 冗余Controller Spans在Spring MVC等框架中,自动插桩默认会为单个Web请求创建多个Spans(Server Span、Controller Span、View Span)。但在现代微服务中,Controller往往很薄(Thin),只是简单转发到Service或数据库。这种情况下,单独的Controller Span(比如显示耗时2ms)几乎没有额外价值,属于明显的冗余Spans。

- 运行时遥测中的thread.name Java运行时指标(如jvm.network.io或jvm.memory.allocation)中默认带上thread.name属性。在使用大线程池或虚拟线程的环境下,这会造成无限数量的唯一时间序列,直接引发基数爆炸。

- 重复的库插桩Java Agent会同时看到多个层(如Upper SDK→Apache HttpClient→Java Networking),为同一个逻辑操作创建多个嵌套Spans。这会导致outbound调用每次都翻倍甚至三倍的遥测量。

- 资源属性,Kubernetes和主机指标的自动检测默认捕获动态唯一标识,如container.id、k8s.pod.uid或process.pid。每次Pod重启或容器重启,这些值都会变,瞬间制造出数千个死时间序列,干扰聚合、增加存储成本、显著拖慢长期趋势查询。

- JDBC和Kafka内部信号,某些模块天生就很“话痨”(Chatty),为内部机制生成高频Spans,但诊断价值很低。例如jdbc-datasource模块每次从连接池取连接(getConnection())就创建一个Span,导致成千上万条“只是确认连接池正常”的记录;Kafka也会为后台心跳和元数据检查产生过多Spans。这些都属于纯噪声。

- 调度器和周期性任务,使用Spring Scheduling或Quartz的后台任务,如果每秒轮询一次数据库或缓存,但99%的时间都没什么有趣的事发生,却为每一次执行都生成Span。一天就能产生86400个成功的但毫无意义的Spans,这在大多数场景下就是遥测浪费。

- SDK不对齐,某些框架(如Trino)会自己初始化独立的OpenTelemetry SDK,而不是加入Java Agent提供的全局实例。这会导致同一个JVM内运行两条并行的遥测管道,内存和网络开销翻倍,而且Spans缺少属性导致在标准查询中“隐形”,变成另一种遥测过剩。

日志易可观测性监控平台——观察易,通过端侧预防+数据遥测管道+后端自动检测等多种方式确保数据是高质量的,是真正有价值的。

1.端侧:提供启动参数主动关闭/抑制低价值部分,避免数据一开始就泛滥。

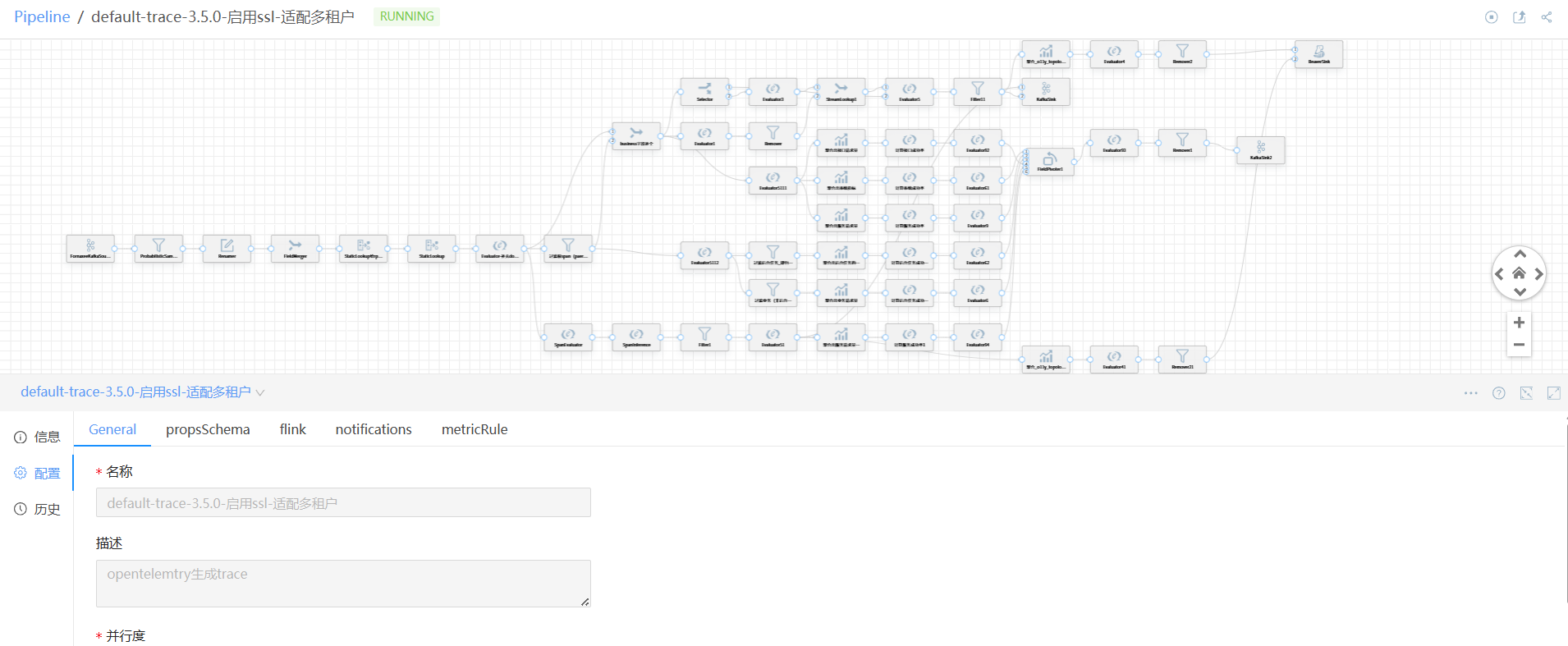

2.遥测管道修剪:提供图形化的管道处理方式,可以灵活的进行管道修剪,比如去掉动态属性如container.id、k8s.pod.uid、process.pid;Drop所有名为Poll、Heartbeat、GetConnection的Spans,后采样配置限制大量Span的Trace等。

3.后端自动检测:自动检测可观测数据质量,包括高基、属性缺失等。

上面只是简单列举了一些常见的问题,实际根据用户的业务、场景和技术栈的不同,会有很多不同的问题,要真正做好可观测性,需要承建方、使用方和Vendor方不断对齐,进行持续的治理和协作。观察易基于三大核心能力——自研高性能搜索引擎Beaver、低代码SPL语言、图形化数据处理平台——实现高效数据接入与高质量可观测数据构建,形成覆盖业务→服务→接口→基础架构的全景观测体系。

- 智能交互+AI能力:通过AI驱动的异常检测、根因分析和智能告警,帮你从海量噪声中快速挖出真信号。

- 全景视图:拓扑图、历史回溯、指标趋势一屏尽览,业务链路追踪+日志串联分析,故障定位从分钟级到秒级。

- 降本增效:内置多种处理器和采样策略,支持端到端遥测优化,实测可大幅降低存储和计算成本。

- 企业级适配:信创兼容、多云/多环境支持,已服务金融、政务、运营商等大型机构,安全合规无忧。